2024/02

[논문리뷰] Swin Transformer - Hierarchical Vision Transformer using Shifted Windows

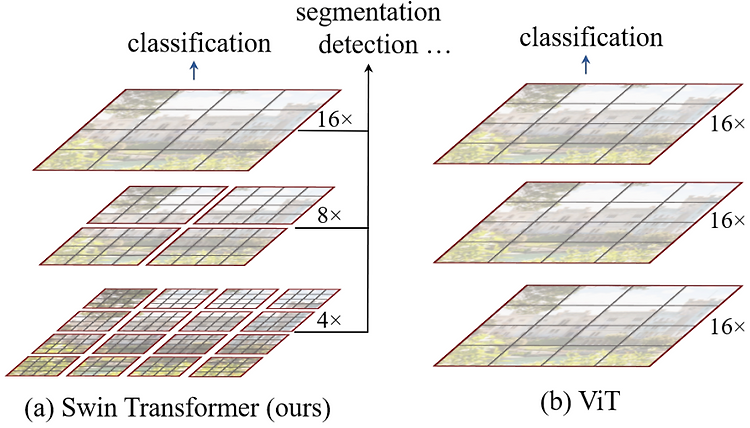

ICCV 2021. [Paper] [Github] Ze Liu, Yutong Lin, Yue Cao, Han Hu, Yixuan Wei, Zheng Zhang, Stephen Lin, Baining Guo Microsoft Research Asia 25 Mar 2021 Introduction 컴퓨터 비전의 모델링은 오랫동안 CNN에 의해 지배되었다. AlexNet과 ImageNet image classification 챌린지에 대한 혁신적인 성능을 시작으로 CNN 아키텍처는 더 큰 스케일, 더 광범위한 연결, 더 정교한 convolution 형식을 통해 점점 더 강력해졌다. 다양한 비전 task를 위한 backbone 네트워크 역할을 하는 CNN과 함께 이러한 아키텍처의 발전은 전체 분야를 광범위하게 끌..

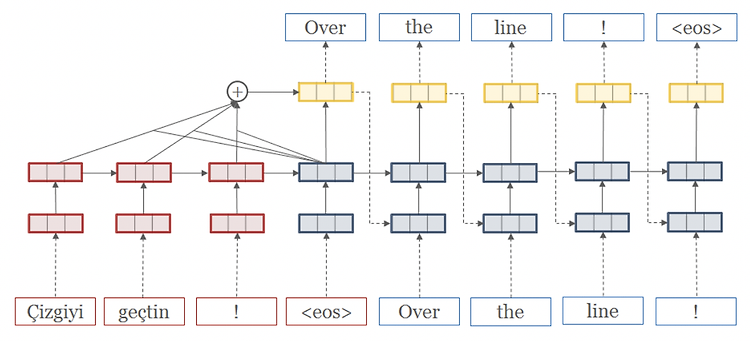

[논문리뷰] Transformer: Attention is All you need

💡 본 문서는 '[논문리뷰] Transformer: Attention is All you need'에 대해 정리해놓은 글입니다. Transformer는 최근 들어 자연어 처리와 비전 분야 모두에서 월등한 성능을 보이면서 발전하고 있다. 이러한 Transformer를 처음으로 제안한 논문이 바로 "Attention is all you need"이며, 자연어 처리를 위해 제안되었지만 최근 비전 쪽에서도 transformer를 많이 다루고, 필자도 연구에서 관련 모델을 사용해야 해서 리뷰를 한 번 해보려고한다. Abstract 기존 sequence transduction model들은 인코더와 디코더를 포함한 복잡한 recurrent 나 cnn에 기반하며, 가장 성능이 좋은 모델 또한 attention mec..

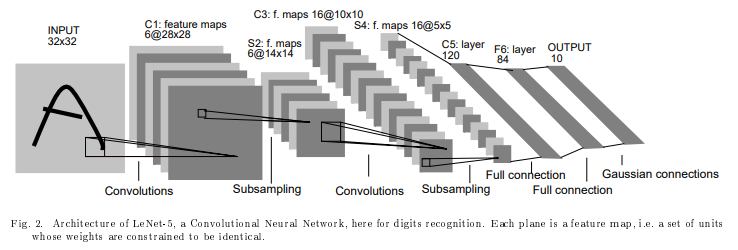

[Perception] CNN Network의 역사 (LeNet-5 부터 ResNet 까지)

💡 본 문서는 '[Perception] CNN Network의 역사 (LeNet-5 부터 ResNet 까지)'에 대해 정리해놓은 글입니다. 최근에 나오는 대부분의 모델이 아직까지 ResNet으로 pretrained 된 모델을 사용하고 있다는 점에서 의아하여, ResNet 구조를 공부하고자 이전부터 ResNet까지의 CNN Nerwork의 역사를 정리하였으니 참고하시기 바랍니다. 1. LeNet-5 (1998) 의의: Convolutional layer와 pooling의 조합을 반복하는 현대적인 CNN 구조를 제안했다는 점에서 의미 Convolution layer(C), sub-sampling(S), Fully-connected layer(F) Convolution Layer: 지역적인 특징 추출 Sub-..