2024/02/07

[논문리뷰] Transformer: Attention is All you need

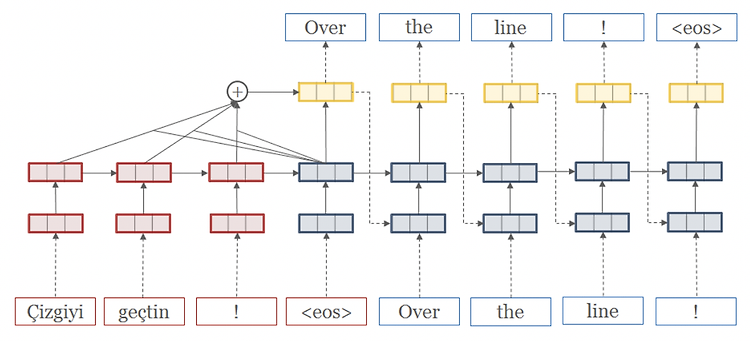

💡 본 문서는 '[논문리뷰] Transformer: Attention is All you need'에 대해 정리해놓은 글입니다. Transformer는 최근 들어 자연어 처리와 비전 분야 모두에서 월등한 성능을 보이면서 발전하고 있다. 이러한 Transformer를 처음으로 제안한 논문이 바로 "Attention is all you need"이며, 자연어 처리를 위해 제안되었지만 최근 비전 쪽에서도 transformer를 많이 다루고, 필자도 연구에서 관련 모델을 사용해야 해서 리뷰를 한 번 해보려고한다. Abstract 기존 sequence transduction model들은 인코더와 디코더를 포함한 복잡한 recurrent 나 cnn에 기반하며, 가장 성능이 좋은 모델 또한 attention mec..